mediaart.robotnet.de

Just another Akustikkoppler Blogs site

Kategorie: Uncategorized

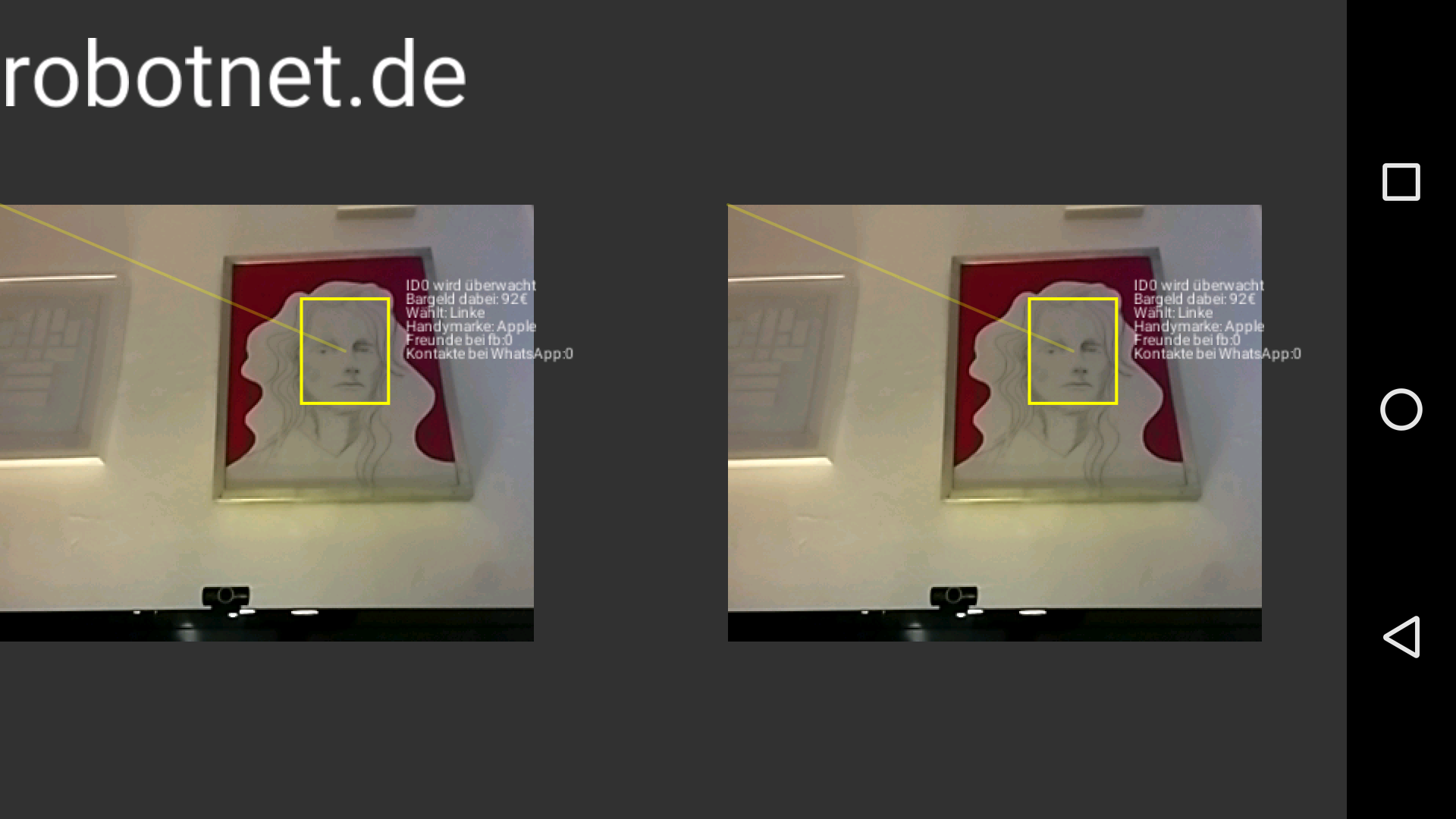

Observed-Installation als Augmented Reality in Hard- und Software

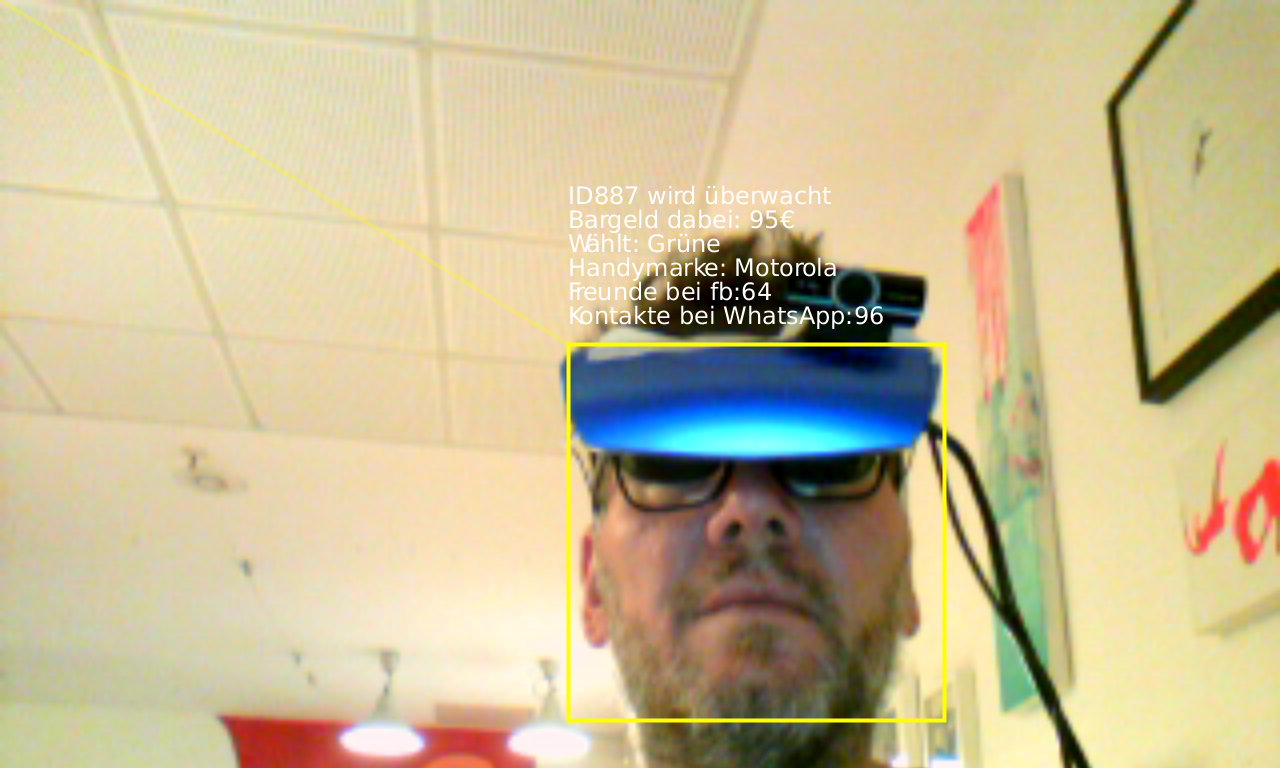

Ich experimentiere derzeit mit einer Augmented Reality Version meiner Observed-Installation. Ziel ist die Installation in Echtzeit als Augmented Reality Darstellung aus dem subjektiven Blickwinkel des Trägers mit Hilfe einer Datenbrille darzustellen.

Approach 1: Eine einfache Hardware Lösung mit Videobrille, montierter USB-Camera und VGA2Video-Umsetzer und externem PC als Zuspieler:

Augmented Reality mit Videobrille, montierter USB-Camera, VGA-Umsetzer und externem PC als Zuspieler

Diese Lösung habe ich sehr schnell realisiert, es ist aber nur Video-(TV)-Auflösung verfügbar. Der Anwender ist nicht sehr beweglich, da Video und USB-Kabel mitgeführt werden müssen.

Approach 2: Realisierung in Software als Android-App:

Das Android-Smartphone wird hier von einer Dive-VR-Brille gehalten. Das Google Cardboard funktioniert natürlich auch! Vorteile: Höhere Beweglichkeit und Skalierbarkeit. Obwohl die Rechenleistung aktueller Smartphones stark zugenommen hat, waren doch ein paar Tricks und Optimierungen nötig, um eine akzeptable Framerate zu erzielen. Die App ist derzeit noch nicht im Android-Store erhältlich.

Das Head Mounted Display (HMD) mit Android Smartphone zeigt Observed in Echtzeit als Augmented Reality Darstellung aus dem subjektiven Blickwinkel des Trägers. Hier realisiert mit DIVE und Nexus4.

Beide Ansätze realisieren nicht wirklich Stereo-Vision, da jeweils nur eine einzige Kamera eingesetzt wird. In der Android- App-Variante kann aber die überlagerte Animation Tiefeninformation enthalten, da die Teilbilder einzeln erzeugt werden. Die Videobrille akzeptiert nur eine einzige Videoquelle, so dass prinzipbedingt kein Stereo-Vision möglich ist. Die App-Variante kann zwei Cameras nutzen, sofern sie im Smartphone verbaut sind (z.B. Oppo) bzw. auch sinnvoll im Augenabstand angeordnet sind. In der Wikipedia findet sich eine Liste von Smartphones, die 3D-Vision unterstützen.

Ich plane die Videobrille mit einem Raspberry pi zero und der Raspi-Camera auszustatten, um sie auch kabellos nutzen zu können.

Update: Die Observed-Installation äuft mit speziellem Video-Library auch auf dem pi zero. Die erreichbare Framerate (ca. alle 3 Sekunde ein Frame) ist aber nicht akzeptabel.

Der klitzekleine raspbery pi zero rendert was das Zeug hält die Observed Installation in 320×240 Auflösung…

… und nimmt dabei nur 5 Watt Leistung auf. Green-Art ;-)

Beitrag zur Extraschicht 2017 – die Nacht der Industriekultur

Der Kulturort Depot ist wieder bei der Extraschicht 2017 dabei gewesen und die Ateliers der Künstler im Depot waren geöffnet. Und so haben auch Heike Kollakowski und ich am 24.6.2017 eine Extraschicht eingelegt und unser gemeinsames Atelier im Büro 14 des Depots geöffnet.

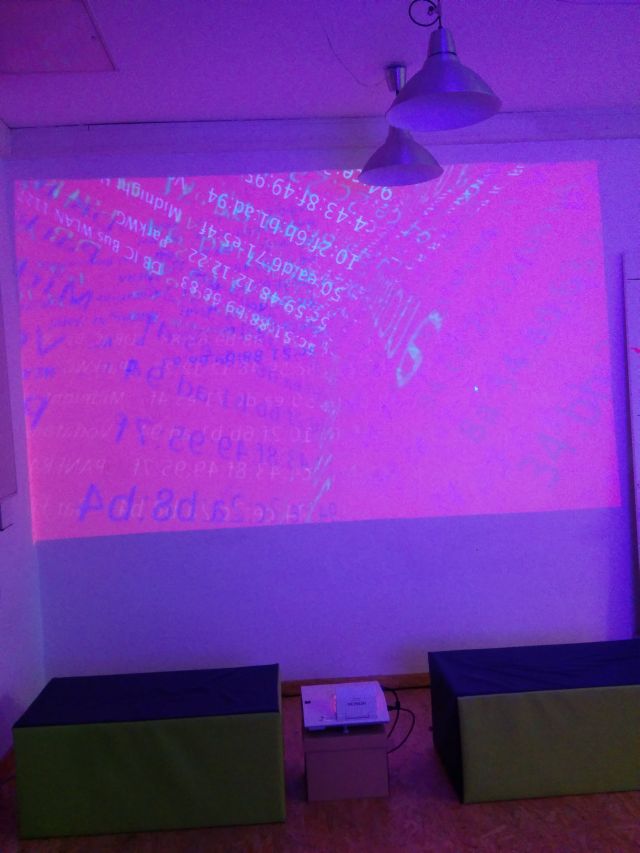

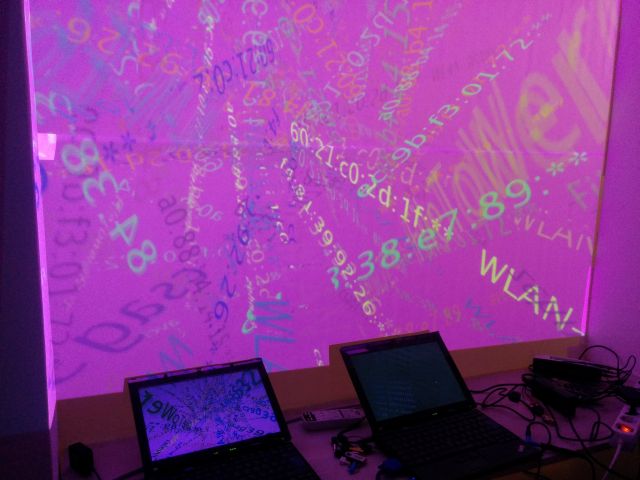

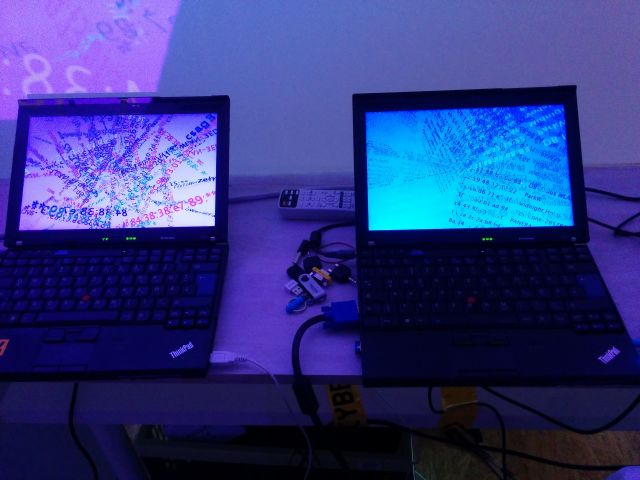

“data cloud” Videoinstallation

Ich habe dort meine neue Videoinstallation “data cloud” gezeigt, die WLAN-MAC-Adressen von Smartphones in WLAN-Reichweite und die von diesen Geräten gesuchten WLAN-Accesspoint als Datengrundlage verwendet.

Die Installation startet mit einem leeren Screen und füllt sich interaktiv bei Annäherung von mit Smartphone ausgestatteten Betrachtern. Voraussetzung ist die eingeschaltete WLAN-Funktion auf den Smartphones der Besucher. Viele Smartphone-Nutzer haben diese Funktion ständig eingeschaltet und sind sich nicht bewusst, dass ihre Geräte so eine Datenspur hinterlassen und getrackt und wiedererkannt werden können. Die Installation soll den Betrachtern das allgegenwärtige Ausstreuen von personenbezogenen Daten bewusst machen und eine Sensibilisierung zu Datenschutz- und netzpolitischen Themen fördern.

Erstmals habe ich die Installation mit zwei großen Beamern präsentiert. Es gab sowohl eine Frontpräsententation mit einem Kurzdistanzprojektor als auch eine Rücktransformation auf Transparentpapier.

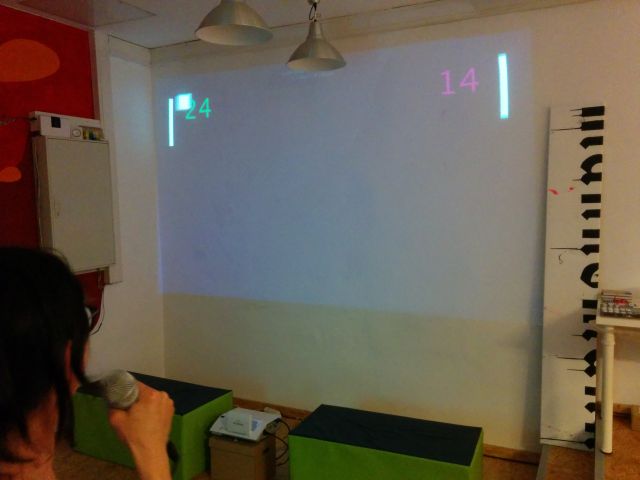

Audio-Pong

Da bei der Extraschicht immer sehr viel Publikum unterwegs ist, habe ich mir dieses Mal etwas Besonderes überlegt. Alternativ zu der großen Videoinstallation konnte ich ein Audio-Pong präsentieren, nachdem die von Heike Kollakowski im Rahmen der Extraschicht angebotenen Handlettering Workshops beendet waren. Das bekannte Pong-Spiel (eine Implementierung in Processing) habe ich um eine Audio-Steuerung ergänzt, die es ermöglicht, dass zwei Spieler per Mikrofon über die Lautstärke der Stimme Ihren Pong-Schläger steuern konnten. Dieses Konzept gab es übrigens schon einmal in den 70′er Jahren im Fernsehen unter dem Namen “Telespiele” moderiert von Thomas Gottschalk. Interessanterweise kannte keiner der Besucher diese Sendung. Ich hatte diese Installation schon einmal im Dezember 2014 bei einer Veranstaltung eingesetzt und später auf der 32C3 eine ähnliche Installation gesehen. Zur Geschichte von Pong gibt es derzeit aktuell noch ein Video in der ZDF-Mediathek zum Download (1,4GB, Die Amiga-Story, alternativ bei youtube).

Auch alte Computer / Telespiele sind meiner Ansicht nach Zeugnisse der Industriekultur. Den Besuchern und auch mir hat die Aktion sehr großen Spaß bereitet, da teils sehr lustige Laute zu hören waren ;-).

Observed 4 für die Extraschicht – Nacht der Industriekultur 2016

Da das Depot Spielort der Extraschicht – Nacht der Industriekultur 2016 am 25.6.2016 war, sind auch viele Ateliers für dieses Event geöffnet gewesen. Wir im Büro 14 waren auch dabei. Heike Kollakowski hat einen Handlettering-Workshop angeboten und ich habe die Gelegenheit genutzt, um die Installation Observed 4 auszustellen. Mit dem sehr engagierten Publikum gab es angeregte und auch kontroverse Diskussionen.

Audio für die “generated”- Installation

Der Live-Stream der Installation „generated“ war nur während der Ausstellungszeiten der offenen Ateliers Dortmund 2016 verfügbar. Hier gibt es aber kurze Aufzeichnung der computergenerierten selbstähnlichen Musik der Installation zum Anhören oder Download.

Die Musik wurde mit Pure Data extended erzeugt. Der Pure Data „Patch“ basiert auf auf einem großartigen Patch von Martin Brinkmann, der von mir um eine Open Sound Control (OSC) und eine Schnittstelle zum Icecast Streaming Server ergänzt wurde. Der Sound des einzigen eingesetzten Synthesizer-Moduls kann mit einem Smartphone per OSC modifiziert werden. Der Musikgenerator von Martin Brinkmann (hier gibt es Ambient-Musik von ihm!) verwendet die fraktale Kompositionsmethode von Lars Kindermann, die dieser für “musinum” implementiert hat. Auch die Idee zu selbstähnlicher Musik stammt ursprünglich von Lars Kindermann, auf dessen Webseite ich auch schon einmal vor einigen Jahren das Projekt PALAOA bei Recherchen zu einer geplanten Teilnahme an Arctic Perspective gefunden hatte.

Teilnahme an den offenen Ateliers Dortmund 2016 – Westlich der B54: 28./29. Mai 2016

Am 21.05.2016 starten die Offenen Ateliers 2016 in Dortmund, die in diesem Jahr aufgrund der Teilnehmerzahl zum ersten Mal an zwei Wochenenden stattfinden. Los geht es dieses Mal mit allen Ateliers und Galerien, die östlich der B54 liegen. Diese Ateliers sind am Samstag den 21.5. von 15-20 Uhr und am Sonntag von 11–18 Uhr geöffnet.

Am Samstag den 28.05. und Sonntag den 29.5. öffnen dann alle Künstler westlich der B54 ihre Türen.

Da der Kulturort Depot an der Immermannstraße 29 knapp westlich der B54 liegt, und ich seit über einem Jahr meinen kleinen Atelierplatz im Büro 14 habe, werde ich mich hier am 28.05. ab 15 Uhr gemeinsam mit der Künstlerin Heike Kollakowski auf interessierte Besucher freuen!

Die Öffnungszeiten an beiden Wochenenden:

samstags 15–20 Uhr

sonntags 11–18 Uhr

Und hier noch einmal die Termine für die Offenen Ateliers 2016:

Östlich der B54: 21./22. Mai 2016

Westlich der B54: 28./29. Mai 2016

Während der Ausstellung gibt es einen Audio-Live-Stream zu einer Installation. Es handelt sich dabei um computergenerierte selbstähnliche Musik, die über Kopfhörer an der Installation gehört werden kann. Der Stream ist aber auch während der Öffnungszeiten weltweit mit jedem Rechner und jedem Smartphone abrufbar. Moderne Smartphones spielen den Stream direkt im Browser ab, ohne das spezielle Audio-Software erforderlich ist.

Alternativ direkt den URL anklicken:

Installation “Observed 2″ beim “ON/LIVE – Das Theater der Digital Natives” Symposium im FFT-Düsseldorf

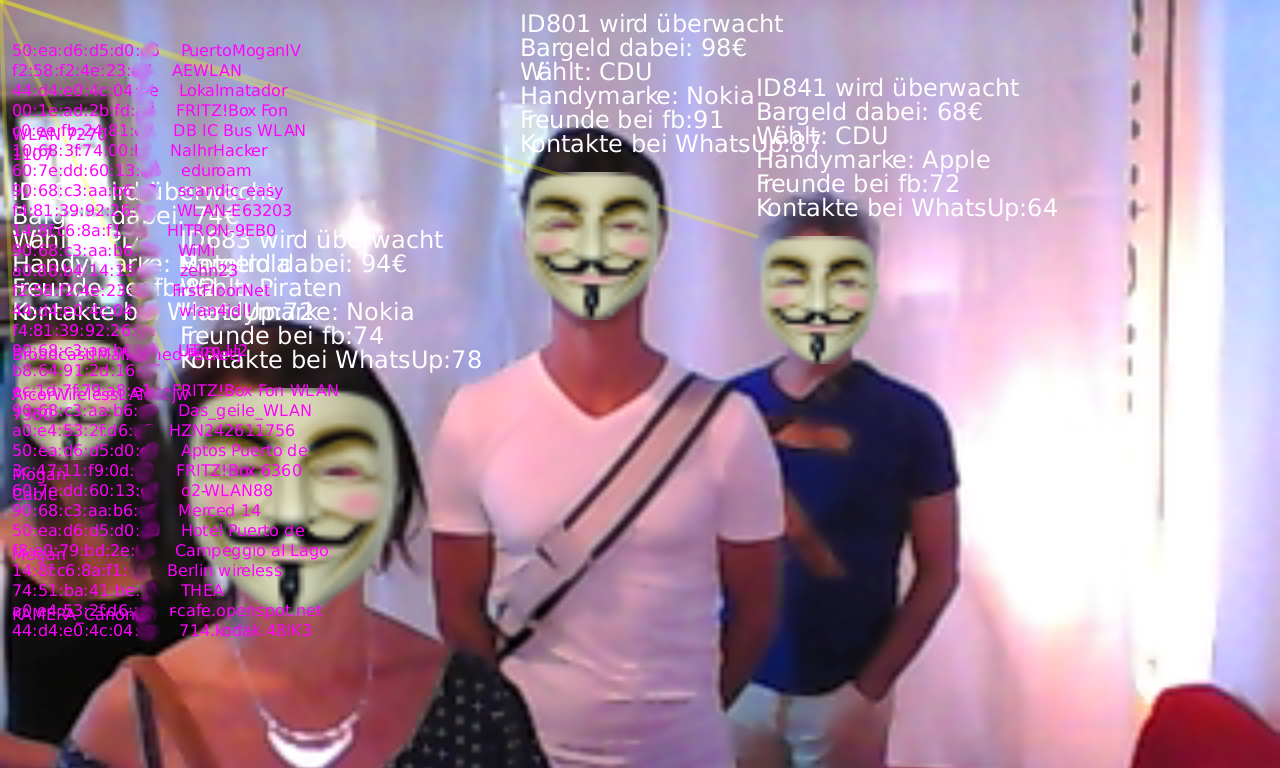

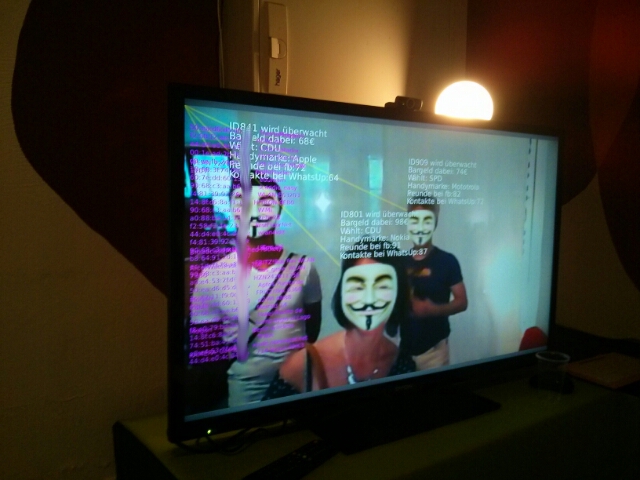

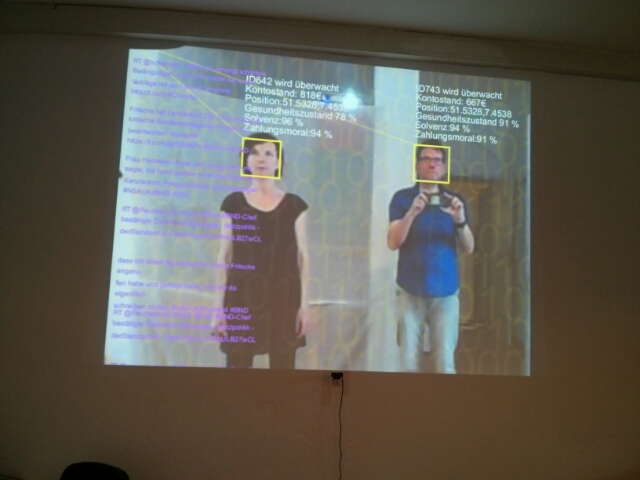

Am 30.1.2016 hatte ich die Gelegenheit, meine Installation “Observed 2″ im Rahmen des ON-LIVE-Symposium des FFT (Forum Freies Theater) in Düsseldorf zu präsentieren. Beim Symposium ging es um Fragen und Thesen zur Kunst in der digitalen Gesellschaft. Neben einem Beitrag von mir zu den Lightning Talks zu digitaler Privatsphäre, konnte ich auch “Observed” in einer neuen Variante “2″ mit live eingeblendeten Namen von WLAN-Netzen, nach denen Smartphones in der Nähe der Installation gesucht haben, präsentieren.

Installation “Observed 2″ mit Live-Hacking Komponente (sichtbare MAC-Adressen wurden durch Bildbearbeitung nachträglich anonymisiert)

Die Live-Daten werden mittels “tshark” (Terminal basiertes Wireshark) aus den WLAN-Profilen von Smartphones in WLAN-Reichweite gewonnen, die ständig nach bekannten WLAN-Netzen in ihrer Umgebung suchen. Auf diese Weise sind Smartphones eindeutig identifizierbar (Fingerprinting). Dieses Verfahren wird auch in Geschäften und Ladenlokalen eingesetzt, um Kunden zu identifizieren und wieder zuerkennen. Dem Betrachter sollen diese überraschenderweise öffentlich sichtbaren Daten bewusst machen, dass seine Anonymität durch sein Smartphone beeinträchtigt wird und er/sie nicht nur visuell durchleuchtet wird.

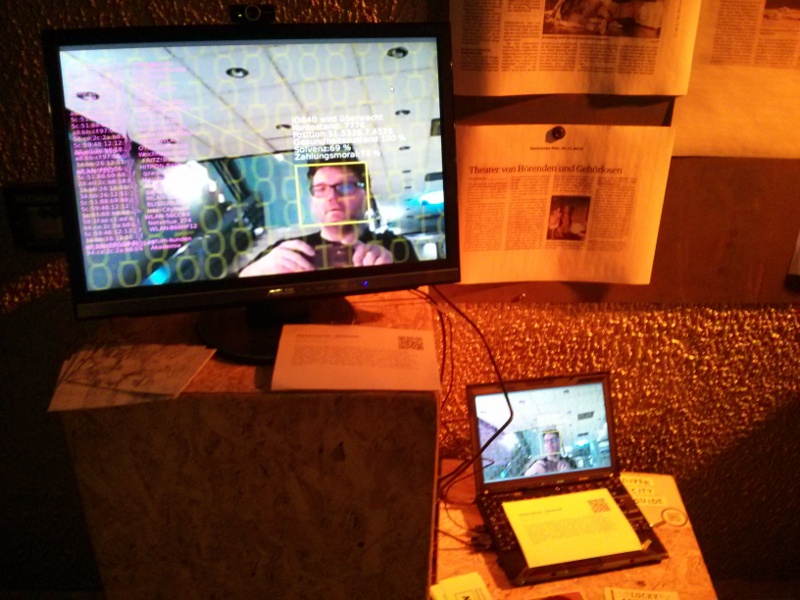

Installation “Observed” bei den offenen Nordstadtateliers

Bei den “offenen Nordstadtateliers 2015” vom 13. bis zum 14. Juni in Dortmund habe ich dieses Mal unter anderem eine ganz neue Arbeit zum Thema Überwachung präsentiert. Das erste Mal im Atelier/Büro im Dortmunder Depot “Büro 14″, das ich mir mit Heike Kollakowski und der Geschichtsmanufaktur teile.

Die Arbeit mit dem Titel „Observed“ soll den Betrachtern die allgegenwärtige Überwachung und die Aggregation von Metadaten bewusst machen. Die interaktive Videoinstallation verfolgt mittels „face tracking“ die Gesichter der Betrachter in Echtzeit und markiert diese. Es werden Daten über jedem beobachteten Gesicht eingeblendet, die keinesfalls öffentlich zugänglich sein sollten, um das Bewusstsein zu schaffen, dass jeder etwas zu verbergen hat. Weiterhin werden aktuelle Tweets zum Hashtag #BND automatisiert eingeblendet, um die Installation in einen aktuellen politischen Kontext zu stellen.

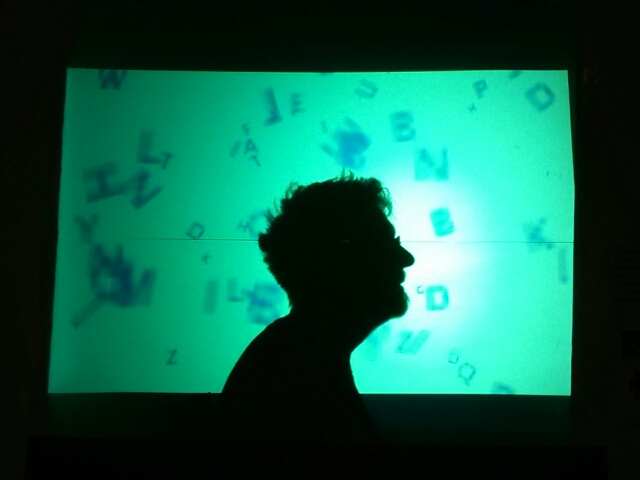

Ausstellung der Installation “time goes by” im Rahmen der offenen Ateliers in Dortmund

Im Rahmen der offenen Ateliers Dortmund war ich zu Gast bei Heike Kollakowski und Alexandra Lippert im GründerinnenZentrum Dortmund und konnte meine neue interaktive Videoinstallation “time goes by” in den großzügigen Schulungsräumlichkeiten dort präsentieren.

Eine typographische Animation mit einer Schar von Schriftzügen mit dem Text “time goes by”, welche in zufälligen Größen und Geschwindigkeiten über den Projektionsbereich bewegt werden, kann hier über einen vor der Videoprojektion hängenden Quader in ihrer Farbanmutung beeinflusst werden. Jede Rotationsachse des Quaders beeinflusst je einen der RGB-Farbwerte der Schriftzüge. Der programmierte Algorithmus tauscht in variierenden Zeitabständen Vordergrund und Hintergrundfarben aus.

Realisiert wurde diese Installation mit Hilfe von Processing und dem Open Sound Control Library. Ein in einem Quader integriertes Smartphone gibt seine Lagesensordaten (X-Y-Z-Orientierung) per WLAN an Processing weiter, wo sie in Echtzeit zu RBG-Farbwerten verarbeitet werden.

Processing – interaktive generative Kunst

Interaktive generative Kunst:

Hier kann der Prozess mit den drei Schiebereglern beeinflusst werden.

1 – Transparenz

2 – Linienstärke

3 – Farbanmutung

(c) 2012